網站建置

腦機介面是一項突破性的技術,可以幫助癱瘓的人恢復失去的功能,例如移動手。割斷或被割斷的神經。

自2006年以來,人類腦機介面的演示主要集中在能夠控製電腦遊標或機械人手臂來手臂恢復和手的運動。 。

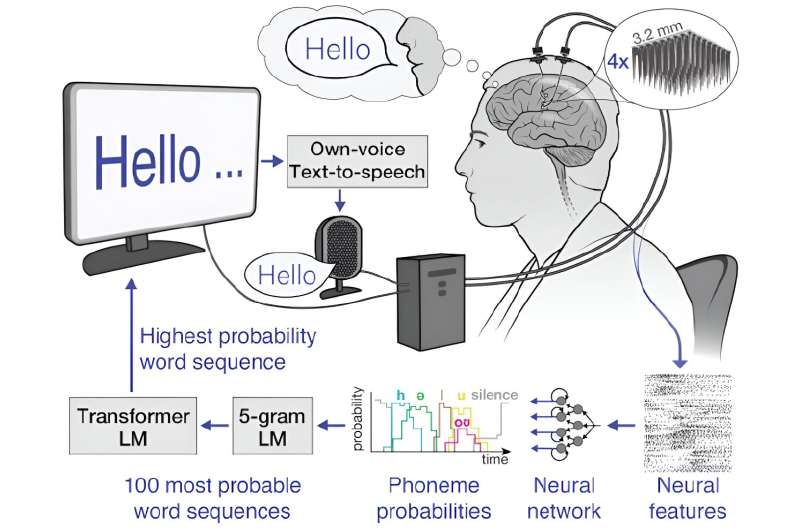

當使用者嘗試說話時,這些腦機介面會記錄該人與嘗試說話的被解剖運動相關的獨特大腦訊號,然後將其翻譯成單字 然後,這些單字可以在螢幕上顯示為文本,或使用文字轉號碼語音軟體大聲朗讀。

我是加州大學戴維斯分校神經修復實驗室的研究員,該實驗室是 BrainGate2 臨床試驗的一部分。

我和我的同事最近展示了一種腦語音機接口,可以破解患有ALS 或肌萎縮側索淋巴瘤症(也稱為盧伽雷氏症)的患者的嘗試言語。 ,準正確率超過97%。

網站建置 記錄大腦訊號

我們的語音腦機介面的第一步是記錄大腦訊號。更近,從而產生更強的訊號,幹擾更少。

在我們的研究中,我們透過手術將電極放置在參與者凱西·哈雷爾的言語運動中,言語運動涉及大腦中控制與言語被切除的部分。電極的神經活動。

網站建置 解碼大腦訊號號

下一個挑戰是複雜的大腦訊號與使用者試圖將問題連結起來。

一種方法將每個神經活動模式直接對應到口語單字。

雖然這個策略對於小詞彙量來說很有效,正如 2021 年 50 個單字詞彙量的研究所證明的那樣,但對於更大的詞彙量來說,它就變得不切實際了。腦機介面使用者多次嘗試記出字典中的每個單詞,這可能需要幾個月的時間,而且對於新單字仍然無法使用。

相反,我們採用另一種策略:將大腦訊息映射到音素,即構成單字的聲音的基本單位。

我們可以透過要求參與者大聲朗讀幾個來多次測量與每個音素相關的神經活動。 。

為了將大腦訊號映射到音素,我們使用先進的機器學習模型。

將這些模型視為聰明超級的聽眾,可以從嘈雜雜亂的大腦訊號中挑選出重要訊息,就像你在擁擠的房間裡專注於能夠對話一樣。嘗試語音期間的音素序列。

網站建置 從音素到單字

一旦我們破解了音素序列,我們就需要將它們轉換成單字和句子。語言模型。

第一個是n-gram語言模型,它預測哪個單字最可能有後面一組「n」個單字。預測單字的可能性,捕捉本地上下文和常用的短語。

利用這個模型,我們將音素序列轉換為100個最可能的單字序列,每個序列都有一個相關的機率。

第二個是大型語言模型,它為人工智能訓練聊天機器人提供動力,並預測哪些單字最有可能緊跟著其他單字。語言結構和意義有更廣泛的理解。

透過仔細平衡n-gram模型、大語言模型和我們最初的音素預測的機率,我們可以對腦機介面使用者想要的事情做出有根據的猜測。不確定性,並產生連貫的、上下文合適的句子。

網站建置 現實世界的好處

在實踐中,這種語音策略解碼非常成功。第一次能夠在舒適的家中輕鬆地與家人和朋友交談。

語音腦機界面代表著恢復溝通方面向前邁出的重要一步。 。

然而,挑戰仍然存在,例如如何使該技術在長期使用中更易於使用、便攜和耐用。

本文根據對話的共享知識授權重新發布。

引文:從思想到語言:人工智能如何破解神經信號以幫助ALS患者說話(2024年8月24日),2024年8月25日搜尋自https://medicalxpress.com/news/2024-08-thoughts-單字-ai-解密-neural.html

本文檔受版權保護。