網頁設計

Jim Fan 是 Nvidia 的高級人工智慧研究員之一。

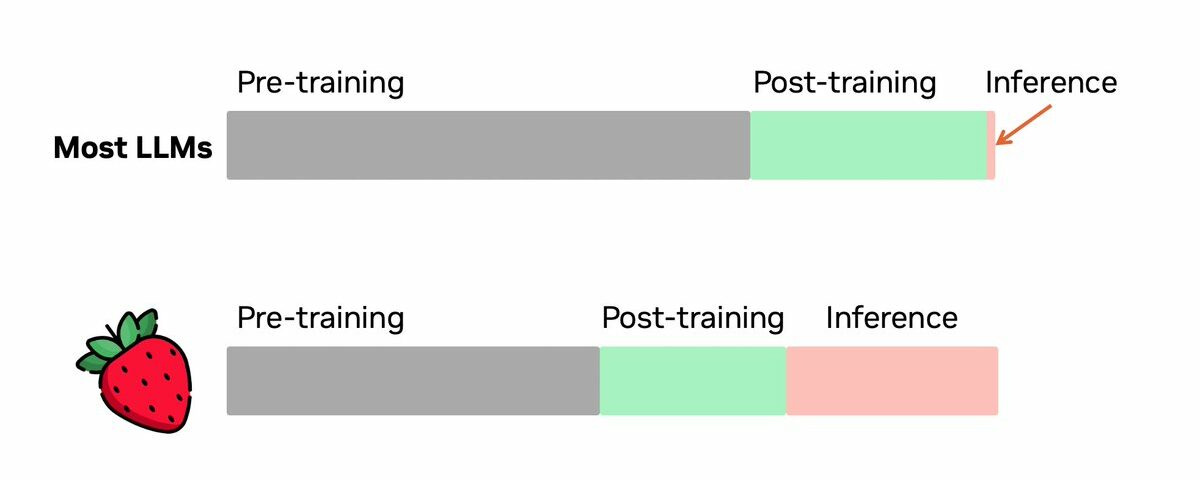

這種轉變可能會使推理所需的計算和能量增加多個數量級,以處理 OpenAI Strawberry (QStar) 方法中改進的推理。

這可能意味著運行推理需要更強大、更耗能的訓練樣本。大部分是人工智能推理大部分是人工智能訓練的平方根。

我們仍然不知道人工智能大型語言模型的集中式訓練需求還是將如何轉變。

Nvidia Jim Fan 所描述的 OpenAI Strawberry

OpenAI草莓(o1)已經出爐! 我們終於看到推理時間擴展的範例在生產中普及和部署。搜尋。

1. 你不需要一個巨大的模型來進行推理。驗證器等工具的小型「推理核心」。

2. 大量計算轉移到推理服務,而不是訓練前/訓練後。過程是一個經過充分研究的問題,就像AlphaGo的蒙特卡羅樹搜尋(MCTS)一樣。

3. OpenAI肯定很早就已經弄清楚了推理縮放調整之前,而學術界最近才發現這個策略。

– 大語言猴子:透過重複樣本延伸推理計算。

– 優化LLM測試時間計算比縮放模型參數更有效。

4. 將o1產品化比確定學術基準困難度。計算成本?

5.草莓很容易成為資料飛輪。

這反過來又改進了 GPT 未來版本的推理核心,類似於 AlphaGo 的價值網絡(用於評估每個棋盤位置的品質)如何隨著 MCTS 產生更多精細的訓練數據而改進。

OpenAI草莓(o1)已經出爐! 我們終於看到推理時間擴展的範例在生產中普及和部署。搜尋。

— 吉姆範 (@DrJimFan) 2024 年 9 月 12 日

OpenAI剛剛發布了新的人工智能模型OpenAI o1(內部稱為Project Strawberry/Q*)

等待終於結束了。

這是根據提示編碼整個視頻遊戲的模型🤯

該模型可以在回答之前進行思考,並且更能提高數學和程式設計的挑戰。

… pic.twitter.com/hIokkdow2T

— Rowan Cheung (@rowancheung) 2024 年 9 月 12 日

Brian Wang是未來主義思想領袖和受歡迎的科學博客,每月擁有100萬讀者。 ,包括太空、機器人、人工智慧、醫學、抗衰老生物技術和納米技術。

他以識別尖端技術而聞名,目前是一家新創公司的聯合創始人,並為高潛力的公司早期募集資金。

他經常在企業發表演講,曾擔任TEDx演講者、奇點大學演講者,並擔任許多電台和播客採訪的主持人。